Inteligența artificială (IA) este tot mai prezentă în viețile noastre, inclusiv în căutarea unor sfaturi rapide și personalizate. Cu toate acestea, specialiștii avertizează asupra unor riscuri semnificative asociate cu utilizarea IA în acest scop. Un studiu recent realizat de Universitatea Stanford evidențiază o problemă majoră: aceste sisteme tind să perpetueze și chiar să amplifice prejudecățile existente.

Prejudecăți și inechități

Principalul pericol identificat de cercetători este tendința algoritmilor de IA de a reflecta informațiile pe care sunt antrenați, inclusiv eventualele discrepanțe și generalizări eronate. Dacă datele de pe care învață un sistem IA sunt părtinitoare, rezultatele vor fi, de asemenea, părtinitoare. Aceasta poate duce la recomandări incorecte sau chiar discriminatorii, în special în domenii precum sănătatea, creditarea sau recrutarea.

De exemplu, un sistem IA antrenat pe date istorice de creditare ar putea sugera, în mod eronat, că persoanele dintr-o anumită categorie demografică sunt mai puțin eligibile pentru un împrumut. Astfel de erori pot avea consecințe grave, afectând accesul la oportunități și perpetuând inechitățile sociale. Chiar și în domenii mai puțin critice, cum ar fi recomandările de produse sau servicii, aceste prejudecăți pot influența negativ experiența utilizatorilor.

Bias-ul algoritmilor și impactul asupra utilizatorilor

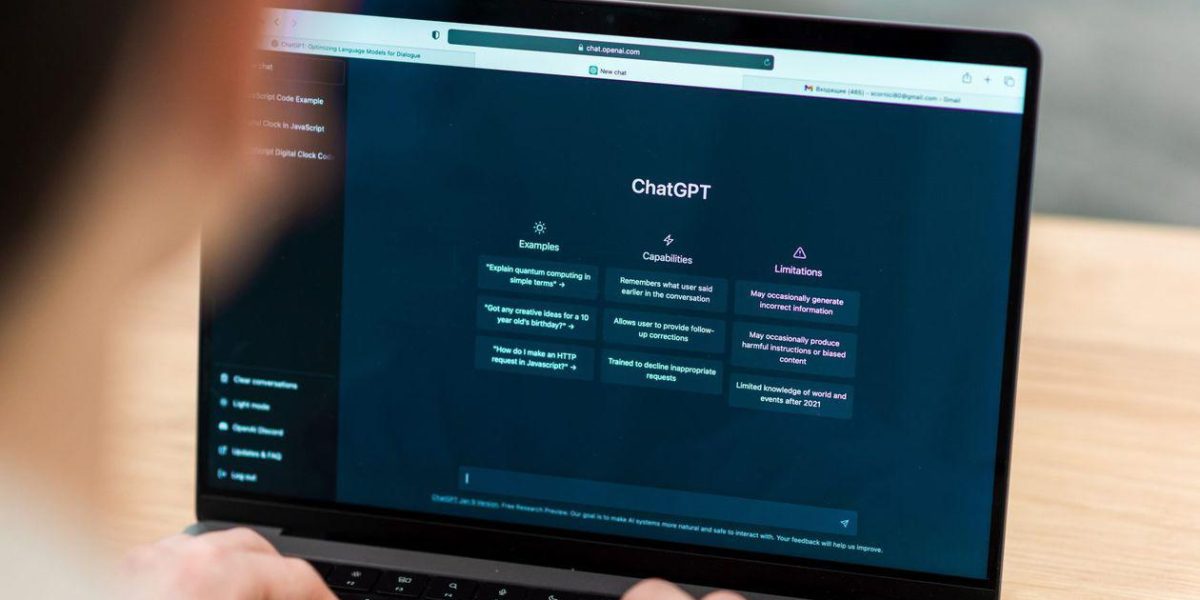

O componentă importantă a problemei este „bias-ul” sau părtinirea algoritmilor. Sistemele de IA sunt dezvoltate pe baza unor seturi mari de date, iar calitatea datelor este esențială pentru acuratețea și obiectivitatea rezultatelor. Cu toate acestea, este dificil – și uneori imposibil – să se asigure că aceste seturi de date sunt complet lipsite de părtinire. Chiar și cele mai recente modele lingvistice, extrem de performante, prezintă uneori aceste erori.

Impactul asupra utilizatorilor este complex. Încrederea excesivă în sfaturile IA poate duce la decizii eronate, mai ales dacă utilizatorii nu sunt conștienți de potențialele limitări și prejudecăți ale sistemelor. Această dependență poate reduce capacitatea de gândire critică și de luare a deciziilor autonome. De asemenea, poate amplifica efectul bulelor informaționale, în care utilizatorii interacționează doar cu informații care le confirmă propriile opinii și prejudecăți.

Standarde etice și reglementare

Pentru a aborda aceste riscuri, sunt necesare eforturi concertate în mai multe direcții. Dezvoltarea unor standarde etice în proiectarea și implementarea sistemelor de IA este esențială. Aceasta include transparența cu privire la modul în care funcționează algoritmii, precum și audituri regulate pentru a identifica și corecta potențialele prejudecăți.

În plus, o reglementare adecvată poate juca un rol important în protejarea utilizatorilor și asigurarea responsabilității. Aceasta ar putea include cerințe pentru testarea riguroasă a sistemelor de IA înainte de lansare, precum și mecanisme de corecție pentru eventualele erori sau discriminări. Este important ca aceste măsuri să fie implementate la nivel global, pentru a evita fragmentarea și ineficiența.

Uniunea Europeană a propus recent o legislație referitoare la IA, care ar putea reprezenta un pas important în această direcție. Acesta prevede o serie de reguli și restricții, cu accent pe utilizarea responsabilă a inteligenței artificiale și protejarea drepturilor fundamentale.