Informații scandaloase despre gestionarea riscurilor în dezvoltarea inteligenței artificiale

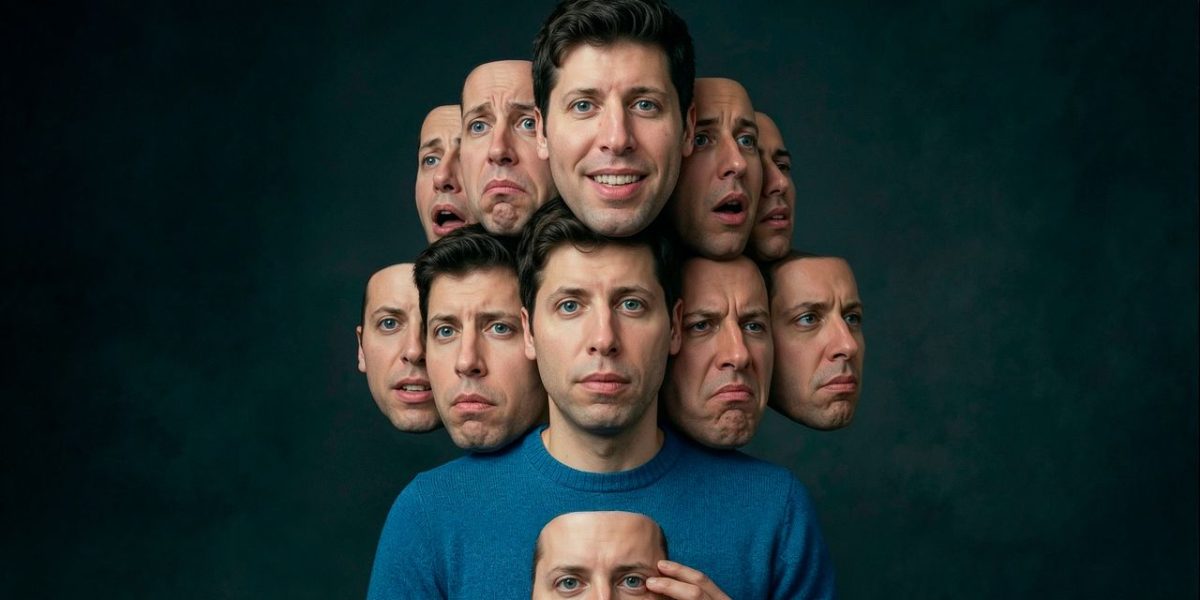

OpenAI, compania cunoscută pentru avansurile sale în domeniul inteligenței artificiale, se află în centrul unui scandal legat de gestionarea riscurilor și transparență. În ultimele luni, au ieșit la iveală informații despre promisiuni neîndeplinite, resurse insuficiente și decizii discutabile referitoare la siguranța produselor dezvoltate, ceea ce ridică semne de întrebare asupra angajamentului real față de securitatea AI.

Promisiuni neîndeplinite și contradicții în strategia de siguranță

În 2022, fondatorul OpenAI, Sam Altman, afirma că compania sa era profund dedicată siguranței inteligenței artificiale și plănuia să aloce un miliard de dolari pentru cercetări în domeniu, inclusiv prin crearea unui premiu internațional pentru studiile în siguranța AI. Un student la doctorat de la Universitatea din California, Berkeley, a fost impresionat de această promisiune și a decis să se alăture companiei, cu speranța că va putea contribui la soluționarea problemelor de siguranță.

Însă, în scurt timp, promisiunile au fost abandonate sau au fost modificate radical. În timpul mai multor întâlniri, Altman nu a mai vorbit despre un premiu global, ci despre formarea unor echipe interne specializate, numite “superaliniament”, însă acestea nu au primit resursele promise. Oficial, compania s-a angajat că aceste echipe vor beneficia de 20% din resursele totale de calcul, echivalentul a peste un miliard de dolari. În realitate, însă, sursele apropiate au declarat că resursele alocate nu au depășit 1-2%, utilizate în special pe cele mai vechi platforme hardware, considerate de specialiști ca fiind ineficiente.

Rezultatul a fost o dezamăgire a cercetătorilor implicați, iar unele voci din cadrul companiei au criticat modul în care resursele au fost alocate, suspectând că hardware-ul performant era rezervat pentru activitățile profitabile ale companiei. Chiar și astfel, oficialii OpenAI au negat aceste acuzații, menționând că toate resursele sunt folosite eficient.

Probleme de transparență și riscuri asumate neclar

Un alt aspect grav este lipsa de transparență în privința siguranței produselor dezvoltate și a procesului de autorizare. În decembrie 2022, membrii Consiliului de Administrație ai companiei au primit informații incomplete despre procesul de verificare a modelului GPT-4, care urma să fie lansat public. Aceștia au fost informați că anumite caracteristici critice, precum posibilitatea de personalizare și utilizarea ca asistenți personali, fuseseră aprobate, însă ulterior s-a descoperit că acestea nu fuseseră analizate sau aprobate oficial.

La scurt timp, a ieșit la iveală faptul că Microsoft, partener strategic al OpenAI, lansase o versiune timpurie a ChatGPT în India fără o evaluare completă a riscurilor de siguranță, fapt necanonic pentru procedurile interne ale companiei. Unul dintre angajații OpenAI, care a fost martor la aceste incidente, a declarat că situația a fost „complet ignorată” de către conducere.

De asemenea, semnalările din interior arată că echipa dedicată siguranței, menită să investigheze „superaliniamente”, a fost lichidată în anul următor, fără ca rezultatele cercetărilor să fie finalizate. Acest lucru a stârnit îngrijorări legate de posibilitatea ca dezvoltarea AI să avanseze rapid, fără o analiză adecvată a riscurilor de dezinhibare sau de disfuncționare periculoasă.

Declarații și reacții oficiale

Dincolo de aceste probleme, fostul director tehnic al companiei, Ilya Sutskever, a devenit mai vehement în exprimarea grijiilor legate de siguranța AI, considerând că dezvoltarea unei inteligențe artificiale generale (A.G.I.) se apropie rapid. În interior, s-a discutat despre o posibilă implicare masivă a tuturor angajaților în cercetări de siguranță, pentru a preveni catastrofe.

Cu toate acestea, pe măsură ce perioada avansată a trecut, mult din aceste inițiative au fost abandonate sau reduse drastic, în condițiile în care acuzațiile de minciuni și omisiuni ale conducerii au devenit tot mai evidente. În ianuarie 2023, o întâlnire cu membrii board-ului a scos în evidență că unele caracteristici ale GPT-4 nu trecuseră încă un control riguros, iar compania păstra în secret anumite lansări și review-uri de siguranță.

După acestea, în cazul în care compania continuă să indice o lipsă de transparență și intenția de a accelera dezvoltarea AI fără un control riguros, riscul unor incidente majore ar putea crește semnificativ. În prezent, nu există informații concrete despre planurile de verficare sau despre măsurile adoptate pentru o transparență totală în procesul de dezvoltare.

Sursa: Newyorker.com